Mistral Small 4: Was das neue 119B‑MoE-Modell für unternehmensweite KI-Workloads bedeutet

17.03.2026

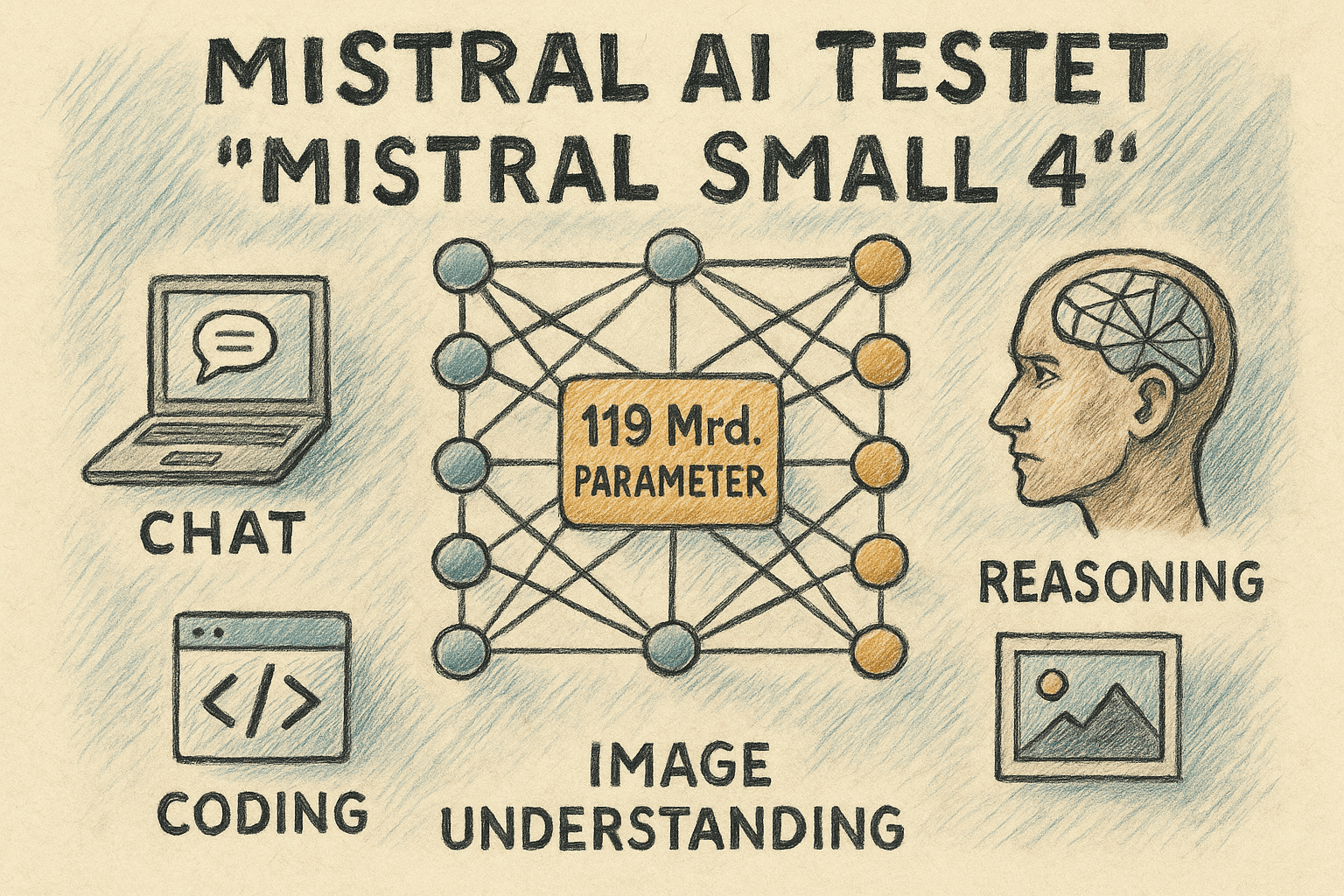

Mistral AI testet mit „Mistral Small 4“ ein neues 119‑Milliarden‑Parameter‑Mixture‑of‑Experts‑Modell, das Chat, Coding, Reasoning und Bildverständnis in einem System vereint. Der heute erstmals in der Community sichtbare Prototyp deutet auf eine neue „Small‑4“-Familie hin, die hohe Performance mit effizienter Inferenz verbindet. Für Unternehmen – insbesondere in Europa – eröffnet das Optionen für souveräne, kosteneffiziente KI-Stacks, die ohne komplexes Modellzoo-Management auskommen und sich für einheitliche Agenten- und Multimodal-Workloads eignen.

Mistral Small 4: Was das neue 119B‑MoE-Modell für unternehmensweite KI-Workloads bedeutet

Überblick: Was heute bekannt wurde

Mistral AI testet mit Mistral Small 4 ein neues Mixture‑of‑Experts (MoE)-Modell mit rund 119 Milliarden Parametern, das erstmals am 17. März 2026 in der Open‑Source‑Community (u. a. über Hugging Face und Foren) sichtbar wurde. Das Modell wird dort ausdrücklich als Teil einer neuen „Small 4“-Familie beschrieben und zielt auf einheitliche Workloads:

Chat & generelle Konversation

Reasoning & Tool-Use

Coding & Code-Refactoring

Bildverständnis (Multimodal, v. a. Vision‑to‑Text)

Im Unterschied zu vielen bisherigen Mistral‑Veröffentlichungen positioniert sich Small 4 klar als Allrounder für Produktionsumgebungen, nicht nur als Forschungsmodell.

Technische Eckpunkte und Architektur-Implikationen

Mixture-of-Experts mit reduzierter Routing-Komplexität

Die Architektur wird in den Community-Diskussionen als MoE‑Setup mit begrenzter Expertenaktivierung beschrieben:

Gesamtgröße ca. 119B Parameter, aber

pro Token werden nur wenige Experten aktiv geschaltet

Ziel: Inference-Kosten nahe „Small“-Modellen, bei deutlich höherer Qualität

Für Unternehmen bedeutet das:

Skalierung wie bei großen Modellen, aber

Kostenprofil eher im Bereich mittelgroßer Modelle,

besser planbare GPU-Auslastung, weil nur Teilnetze aktiv sind.

Ein Modellkern für Chat, Code und Vision

Im Fokus steht ein einheitlicher Modellkern, der mehrere bisher getrennte Modelltypen ersetzt:

kein separater „Code‑Model“-Endpunkt nötig

kein zusätzliches Vision‑Backend für Bildbeschreibungen oder Diagramm‑Parsing

ein gemeinsames Embedding- und Attention-Backbone, auf dem domänenspezifische Fähigkeiten über Training/Fine-Tuning konsolidiert sind

Praktische Konsequenz:

weniger Modellzoo-Management (Versionen, Sicherheitsfreigaben, Monitoring)

einheitliche Guardrails, Logging und Policy-Frameworks

geringere Integrationskosten in MLOps‑Pipelines

Infrastruktur: NVFP4, Docker‑Toolchain und GPU-Anbindung

In den ersten Setups wird explizit auf eine NVFP4‑Quantisierung und eine Docker‑basierte Bereitstellung verwiesen.

NVFP4: Günstigere Inferenz bei stabiler Qualität

NVFP4 (NVIDIA‑optimierte 4‑Bit‑Formate) erlaubt:

drastische Senkung des Speicherbedarfs pro Parameter

bessere GPU‑Auslastung für große MoE‑Modelle

im Vergleich zu klassischen 8‑Bit‑Quantisierungen meist geringeren Qualitätsverlust

Für IT‑Leiter und Cloud‑Architekten heißt das:

119B‑Modelle werden auf deutlich weniger High‑End‑GPUs betreibbar

On‑Prem‑Cluster mit 4–8 modernen GPUs können realistisch unternehmensweite Workloads bedienen

TCO‑Berechnungen für GPU‑Beschaffung fallen günstiger aus, insbesondere bei Multi‑Tenant‑Szenarien im Unternehmen

Docker‑Toolchain: Standardisierter Deployment‑Pfad

Die bereitgestellten Docker‑Artefakte signalisieren einen Fokus auf:

Reproduzierbare Builds (klar definierte Images per Tag/Hash)

einfache Integration in Kubernetes, OpenShift und Nomad

vereinheitlichte Monitoring‑ und Logging‑Schnittstellen (Prometheus, OpenTelemetry etc.)

Unternehmen können damit schneller:

Test‑Umgebungen (Staging) aufsetzen

A/B‑Tests zwischen Small‑3‑ und Small‑4‑Generationen fahren

Rollbacks bei Qualitätsregressionen automatisieren

Anwendungsfälle: Wo Mistral Small 4 besonders interessant ist

1. Enterprise‑Chatbots mit Tool-Use

Ein einheitliches Modell erleichtert:

interne Support‑Bots (IT, HR, Einkauf) mit Zugriff auf interne Tools

Wissensassistenten für Richtlinien, Verträge, Compliance

Agenten‑Workloads, die Dokumente lesen, Aktionen vorschlagen und Workflows auslösen

Mit MoE‑Architektur können komplexere Reasoning‑Tasks bedient werden, ohne dass jede zusätzliche Kapazität die Inferenzkosten linear hochtreibt.

2. Developer Productivity und Code-Automatisierung

Für Engineering‑Organisationen:

Code‑Completion und -Refactoring in IDEs

Migrationen (z. B. von Legacy‑Stacks auf moderne Frameworks)

Testfall‑Generierung und einfache statische Analysen

Da Chat, Code und Dokumentation im selben Modell liegen, können z. B. Änderungsvorschläge direkt aus Jira‑Tickets und Architekturdokumenten abgeleitet werden, ohne zwischen Modellen zu wechseln.

3. Multimodale Workflows im Fachbereich

Beispiele:

Versicherung: Schadensfotos verstehen, mit Textmeldungen kombinieren, Vorschlag für Regulierung erzeugen

Fertigung: Fotos von Bauteilen mit Prüfprotokollen verknüpfen, Abweichungen markieren

Healthcare / Life Sciences: Diagramme, Tabellen und Befunde zusammenfassen (unter Beachtung regulatorischer Vorgaben)

Hier reduziert ein einheitliches Modell die Notwendigkeit, Bild- und Textmodelle getrennt zu orchestrieren.

Strategische Bedeutung für europäische Unternehmen

Alternative zu US‑zentrischen Closed‑Source‑Stacks

Mistral positioniert sich explizit als europäischer Anbieter. Ein leistungsfähiges Small‑4‑Modell mit potenziell offener oder zumindest unternehmensfreundlicher Lizenz ist für europäische Firmen strategisch relevant:

Souveränität: größerer Gestaltungsspielraum bei Hosting und Datenhaltung

Compliance: bessere Kontrolle über Speicherorte, Auditlog‑Tiefe und Integrationspfade

Verhandlungsposition: geringere Abhängigkeit von einzelnen hyperskalierenden US‑Cloud‑Anbietern

On‑Prem- und Hybrid‑Szenarien realistisch machbar

Durch NVFP4‑Quantisierung und Docker‑Toolchain werden Architekturen attraktiv, in denen:

sensible Workloads On‑Prem laufen (z. B. personenbezogene oder medizinische Daten)

weniger kritische Use Cases in der Public Cloud betrieben werden

ein gemeinsames Policy‑ und Governance‑Framework beide Welten abdeckt

Unternehmen können so schrittweise migrieren, ohne sofort alle Workloads in die eine oder andere Richtung zu verschieben.

Empfehlungen für Entscheider in der Pilotphase

1. Technische Evaluierung in klar abgegrenzten Piloten

Zwei bis drei konkrete Use Cases auswählen (z. B. interner IT‑Support‑Chat, Code‑Review‑Assistenz, visueller Dokumentenparser)

Metriken definieren: Antwortqualität, Latenz, GPU‑Kosten pro 1.000 Anfragen, Fehlerraten

Small 4 gegen bestehende Modelle (z. B. Mistral Small 3, Llama, Closed‑Source‑APIs) A/B‑testen

2. Infrastruktur- und Beschaffungsplanung anpassen

GPU‑Kapazität anhand der MoE‑spezifischen Auslastungsprofile neu kalkulieren

Container‑ und Orchestrierungsstrategie (Kubernetes etc.) an Mistrals Docker‑Ansatz angleichen

Observability‑Stack (Logs, Metriken, Traces) von Beginn an aufsetzen

3. Governance, Sicherheit und Lizenzierung klären

Lizenz- und Nutzungsbedingungen des Modells frühzeitig mit Legal & Compliance prüfen

Datenflüsse (Prompt‑Logging, Fine‑Tuning‑Daten, Telemetrie) kartieren und freigeben lassen

Guardrails (Content‑Filter, PII‑Handling, Red‑Teaming) vor Produktionsstart etablieren

Fazit: Nächste Welle effizienter Allround-Modelle

Mistral Small 4 markiert den Übergang zu einer neuen Generation von leistungsfähigen, aber effizienten Open‑Modellen, die Chat, Coding und Multimodalität in einem System bündeln. Für Unternehmen – insbesondere in Europa – ist das eine Gelegenheit, KI‑Strategien neu zu justieren: weg von fragmentierten Modelllandschaften und hin zu einheitlichen, souveränen KI‑Kernen, die technisch und wirtschaftlich tragfähig sind.

Häufig gestellte Fragen (FAQ)

Was ist Mistral Small 4 und worin unterscheidet es sich von bisherigen Mistral‑Modellen?

Mistral Small 4 ist ein Mixture‑of‑Experts‑Modell mit rund 119 Milliarden Parametern, das Chat, Coding, Reasoning und Bildverständnis in einem System vereint. Anders als viele frühere Mistral‑Releases ist es explizit als produktionsreifer Allrounder für unternehmensweite Workloads positioniert und nicht nur als reines Forschungsmodell.

Wie funktioniert die Mixture‑of‑Experts‑Architektur von Mistral Small 4 technisch?

Bei Mistral Small 4 werden zwar insgesamt etwa 119 Milliarden Parameter vorgehalten, aber pro Token nur wenige spezialisierte Expertenmodule aktiv geschaltet. Dadurch bleiben die Inferenzkosten näher an mittelgroßen „Small“-Modellen, während Qualität und Skalierbarkeit eher der Klasse großer Modelle entsprechen. Das führt zu besser planbarer GPU‑Auslastung bei höherer Modellkapazität.

Welche Vorteile bietet Mistral Small 4 für unternehmensweite KI‑Workloads konkret?

Unternehmen können mit Mistral Small 4 Chat, Code‑Assistenz, Reasoning und Vision‑Tasks über einen einheitlichen Modellkern abdecken. Das reduziert Modellzoo‑Komplexität, vereinfacht Governance (Guardrails, Logging, Policies) und senkt Integrations‑ und Betriebskosten, weil weniger verschiedene Modelle bereitgestellt und überwacht werden müssen.

Welche Rolle spielen NVFP4‑Quantisierung und Docker‑Toolchain bei Mistral Small 4?

Die NVFP4‑Quantisierung reduziert den Speicherbedarf pro Parameter und ermöglicht es, ein 119B‑MoE‑Modell auf deutlich weniger High‑End‑GPUs effizient zu betreiben. Die Docker‑Toolchain liefert reproduzierbare Images, erleichtert Integration in Kubernetes‑Umgebungen und unterstützt standardisierte Monitoring‑ und Logging‑Schnittstellen für den produktiven Betrieb.

Warum ist Mistral Small 4 für europäische Unternehmen strategisch interessant?

Als europäischer Anbieter ermöglicht Mistral souveränere KI‑Stacks mit besserer Kontrolle über Hosting‑Standorte, Datenhaltung und Compliance‑Anforderungen. Mit Small 4 können Unternehmen On‑Prem‑ und Hybrid‑Szenarien realistischer umsetzen und ihre Abhängigkeit von US‑zentrierten, geschlossenen Cloud‑Stacks reduzieren.

Für welche Anwendungsfälle eignet sich Mistral Small 4 besonders gut?

Geeignete Anwendungsfelder sind Enterprise‑Chatbots mit Tool‑Use, Developer‑Assistenz (Code‑Completion, Refactoring, Testfall‑Generierung) und multimodale Workflows in Fachbereichen wie Versicherung, Fertigung oder Healthcare. Über den gemeinsamen Modellkern lassen sich Text‑, Code‑ und Bildaufgaben konsolidiert abbilden, ohne separate Spezialmodelle orchestrieren zu müssen.

Was sollten Unternehmen jetzt konkret tun, um Mistral Small 4 zu evaluieren?

Unternehmen sollten zunächst 2–3 klar umrissene Pilot‑Use‑Cases definieren und Small 4 in A/B‑Tests gegen bestehende Modelle in Bezug auf Qualität, Latenz und GPU‑Kosten messen. Parallel dazu empfiehlt sich eine Aktualisierung der GPU‑ und Container‑Strategie, der Aufbau eines Observability‑Stacks sowie die frühzeitige Klärung von Lizenzierung, Datenflüssen und Guardrails gemeinsam mit Legal und Compliance.