Eluvios „Bucharest Release“: Inline-AI-Video-Intelligence verändert Live-Sport- und Streaming-Workflows

07.04.2026

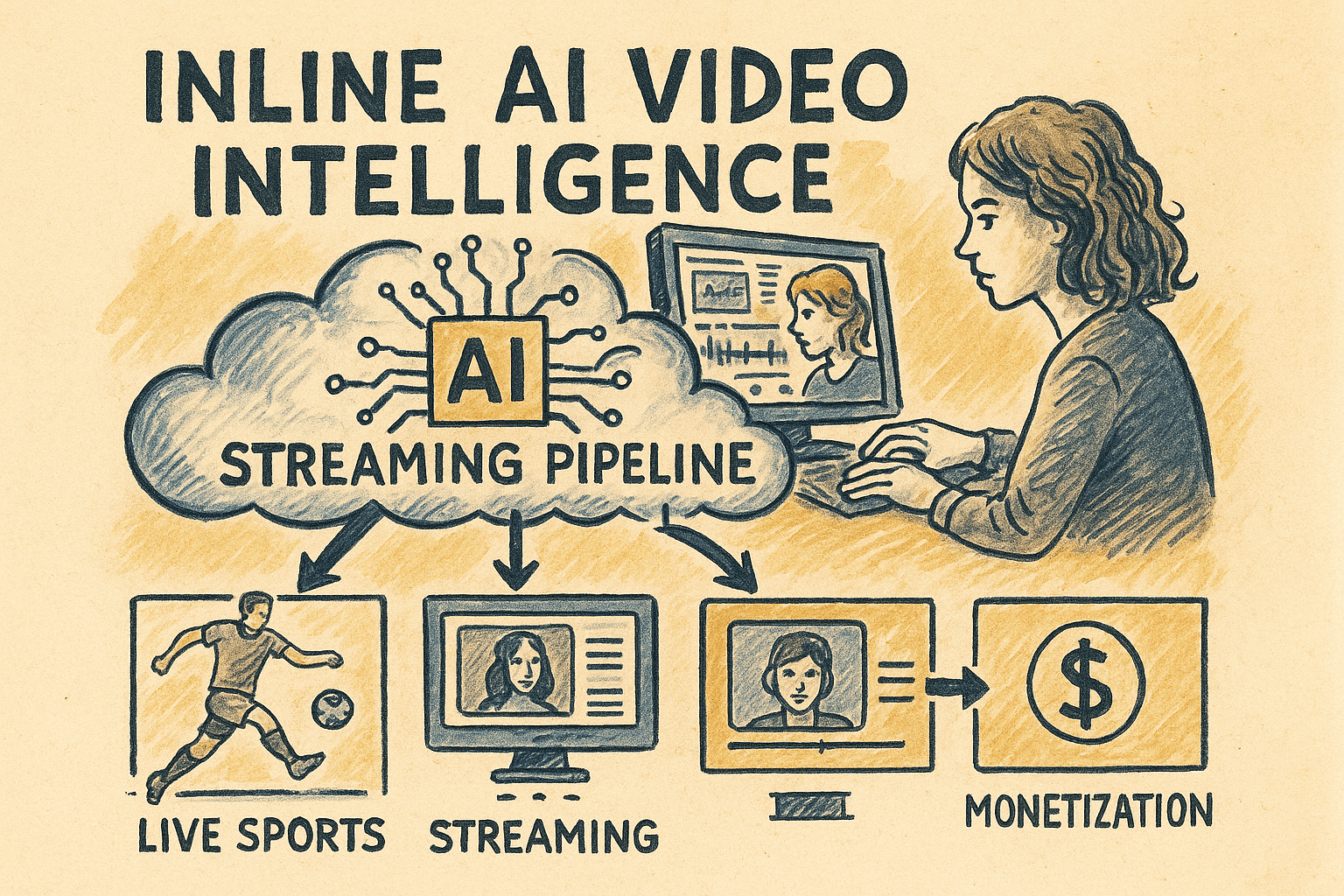

Eluvio hat mit dem Content Fabric „Bucharest Release“ und dem neuen Video Intelligence Editor EVIE eine Architektur vorgestellt, bei der KI-Analyse direkt im Kern der Streaming-Pipeline läuft – ohne Datei-Kopien oder erneutes Transcoding. Der Beitrag erklärt, wie diese Inline-AI-Video-Intelligence Live-Sport, D2C-Streaming und Monetarisierung verändert, welche Effekte das auf Infrastrukturkosten, Workflows und bestehende CDN-/MAM-Systeme hat und welche strategischen Optionen sich für Broadcaster, Ligen und Rights Holder jetzt eröffnen.

Eluvios „Bucharest Release“: Inline-AI-Video-Intelligence verändert Live-Sport- und Streaming-Workflows

Überblick: Was Eluvio heute vorgestellt hat

Eluvio hat am 7. April 2026 zwei zentrale Neuerungen angekündigt:

Content Fabric „Bucharest Release“ als unified Plattform für:

- Zero-Copy Broadcast-Distribution

- D2C-OTT-Streaming inklusive Monetarisierung

- Inline AI Video Intelligence direkt in der Fabric.

Eluvio AI und den neuen Video Intelligence Editor EVIE, der frame-genaue, multimodale KI-Analysen und -Aktionen direkt auf Live-Feeds und Archivbestände ermöglicht, ohne zusätzliche Dateikopien oder separate Analyse-Pipelines.

Damit verschiebt sich KI-gestützte Videoanalyse technisch vom Postproduktions-Add-on zu einem integralen Bestandteil des Distributions-Stacks.

Technische Kernidee: Inline statt Batch

Wegfall klassischer Medien-Pipelines

In traditionellen Setups sind folgende Schritte üblich:

Ingest des Live-Signals

Transcoding und Distribution über CDN

Separater Export oder Mitschnitt für KI-Analyse

Batch-basierte Verarbeitung (Speech-to-Text, Objekterkennung, Szenenerkennung)

Rückimport von Metadaten in MAM-/Publikationssysteme.

Eluvio umgeht einen Großteil dieser Komplexität durch eine Content Fabric, in der das Video als adressierbares Objekt gespeichert und verteilt wird. KI-Analyse und -Transformationen laufen nun inline in derselben Fabric, also:

ohne Dateikopien (Zero-Copy)

ohne erneutes Transcoding für Analysezwecke

mit frame-genauer Adressierung für Clips, Kapitel und Highlights.

Für Betreiber bedeutet das: Analyse-Latenz, Speicherung und Cloud-Egress fallen deutlich geringer aus, weil nicht mehr ganze Streams exportiert und erneut verarbeitet werden müssen.

Rolle von EVIE im Workflow

Der Eluvio Video Intelligence Editor (EVIE) fungiert als zentrale Oberfläche und API-Schicht für:

KI-gestützte Erkennung von Szenen, Spielern, Objekten und Ereignissen

automatische Generierung von Clips, Kapiteln und Markern

Bearbeitung und Freigabe von Highlight-Paketen

Ansteuerung weiterer agentischer KI-Prozesse (z. B. automatisierte Erstellung von Social-Media-Versionen oder personalisierten Feeds).

EVIE greift dabei direkt auf die Fabric-Objekte zu, statt mit exportierten Dateien zu arbeiten. Das ist der entscheidende Architekturunterschied.

Konkrete Anwendungsfälle im Live-Sport

1. Near-Real-Time-Highlighting für Multi-Rechte-Umgebungen

Sportligen und Broadcaster können:

Tor-, Punkt- oder Key-Play-Ereignisse automatisiert über Inline-KI erkennen

Highlight-Clips in Sekunden generieren und mit Metadaten (Teams, Spieler, Uhrzeit, Wettbewerb) anreichern

denselben Content über unterschiedliche Rechte-Templates und Branding-Pakete für verschiedene Distributionspartner ausspielen.

Beispiel:

Eine internationale Fußballliga produziert ein zentrales World-Feed-Signal.

EVIE markiert Tore, Karten, VAR-Szenen und Top-Chancen frame-genau.

Für jeden Markt (z. B. DACH, Nordamerika, APAC) werden automatisiert Highlight-Reels mit lokaler Sprache, Sponsor-Overlays und Rechteeinschränkungen generiert.

2. Personalisierte Fan-Feeds

Da die KI-Metadaten direkt in der Fabric liegen, können Plattformen:

Spieler-, Team- oder Event-basierte Feeds erzeugen (z. B. „Alle Szenen von Spieler X“)

Wunschlängen (15 Sekunden Short, 90 Sekunden Recap, 10 Minuten Extended) dynamisch zusammenstellen

Sponsoring und Commerce-Elemente (z. B. Trikot-Kauf, Wetten, Tickets) pro Clip personalisiert einblenden.

Für D2C-Anbieter ergibt sich damit ein praktisch unbegrenzter Raum für „mass-personalized“ Streams, ohne dass jeder Feed physisch als neue Datei erzeugt werden muss.

3. Effizienzgewinne in der Rechteverwertung

Rechteinhaber können Archive und Live-Rechte effizienter monetarisieren:

Schnelles Finden relevanter Szenen über KI-gestützte Suche

Automatisierte Erstellung paketierter Rechte-Angebote (z. B. „Top-100-Tore einer Saison“)

Vereinfachte Kooperation mit Sponsoren, die konkrete Ereigniskategorien (z. B. „alle Game-Winner“) buchen.

Auswirkungen auf Infrastruktur und Kosten

Reduzierte Cloud-Egress- und Speicherkosten

Da Analyseprozesse im selben System wie Distribution laufen, sinkt der Bedarf an:

separatem Object Storage für Analyse-Kopien

Export/Import über generische Cloud-Speicherdienste

doppeltem oder dreifachem Transcoding für verschiedene Systeme.

Für größere Sportorganisationen und Broadcaster mit globalen Feeds kann dies signifikante OPEX-Einsparungen bedeuten, insbesondere dort, wo bisher mehrere Clouds und CDNs im Einsatz sind.

Konsolidierung getrennter Systemwelten

Die Bucharest-Architektur adressiert drei bisher oft getrennte Funktionsbereiche:

Broadcast-Distribution

OTT-Streaming inkl. ABR, DRM und Commerce

KI-Analyse und Orchestrierung.

Für Unternehmen stellt sich strategisch die Frage:

Welche MAM-, Transcoding- und Analyse-Systeme werden mittelfristig noch benötigt?

Wo lassen sich heute bestehende, komplexe Integrationen (API-Brücken, ETL-Pipelines) zurückbauen?

Eine Konsolidierung auf eine Fabric-Architektur kann langfristig die Integrations- und Betriebskomplexität deutlich senken – erfordert aber eine klare Migrationsplanung.

Agentische Orchestrierung statt statischer Workflows

Von definierten Pipelines zu KI-gesteuerten Abläufen

Mit Eluvio AI und EVIE verschiebt sich das Paradigma:

Statt starrer „Ingest → Transcode → Analyse → Publish“-Pipelines

hin zu agentischen Prozessen, die über APIs nach Bedarf Clips, Versionen, Metadaten und Commerce-Elemente in Echtzeit erzeugen.

Für Medienunternehmen bedeutet das:

Workflows werden mehr durch Policies und Events als durch starre Workflow-Engines gesteuert.

Neue Geschäftsmodelle (Micropayments pro Szene, dynamische Bundles, personalisierte Pakete) lassen sich schneller testen.

Beispiel: Automatisierte Social-Distribution

Ein Live-Rechteinhaber könnte etwa folgende Policy definieren:

„Erstelle für jedes Tor eines bestimmten Spielers innerhalb von 60 Sekunden einen vertikalen 20-Sekunden-Clip, versehe ihn mit Sponsor-Branding, generiere eine Kurzbeschreibung aus KI-Text und poste ihn über definierte APIs auf Plattformen X und Y.“

EVIE liefert hierfür die Ereigniserkennung, Clip-Grenzen und Metadaten; die Fabric sorgt für Ausspielung und Versionierung.

Implikationen für bestehende Anbieter und Ökosysteme

Druck auf CDNs, Cloud- und MAM-Anbieter

Die Integration von Distribution, Analyse und Monetarisierung in einem Stack stellt die bisherige Rollenverteilung in Frage:

CDNs: Werden zunehmend zu „reinen Rohleitungen“, wenn mehr Wertschöpfung direkt in Content Fabrics stattfindet.

Public-Cloud-Video-Stacks: Müssen auf Inline-KI-Szenarien reagieren, bei denen Kunden keine separaten KI-Services und Storage-Layer mehr wollen.

MAM-/Asset-Management-Systeme: Müssen sich über offene Integrationen, Spezialfunktionen oder Nischen (z. B. Newsroom-Workflows, Archiv-Kuration) differenzieren.

Chancen für Partner und Integratoren

Gleichzeitig entstehen neue Aufgabenfelder:

Design von domänenspezifischen KI-Modellen (z. B. für bestimmte Sportarten)

Aufbau von Governance- und Compliance-Layern rund um KI-generierte Highlight-Pakete und personalisierte Werbung

Integration von Fabric-API, EVIE und bestehenden Business-Systemen (CRM, Ticketing, eCommerce, Wettplattformen).

Handlungsempfehlungen für Entscheider

Für Broadcaster, Sportligen und Plattformbetreiber ergeben sich kurzfristig drei zentrale Schritte:

Architekturanalyse: Bestehende Workflow-Kette (Ingest, Transcoding, CDN, Analyse, MAM, OTT) kartieren und identifizieren, wo Doppelstrukturen existieren.

Pilotierung eines Inline-AI-Use-Cases: Konkretes Szenario wählen, z. B. Highlight-Automatisierung für eine Liga oder ein Event, und gegen heutige Kosten/Latenzen benchmarken.

Strategische Roadmap: Festlegen, ob und wie stark man sich in Richtung einer konsolidierten Fabric-Architektur bewegen will – inklusive Auswirkungen auf bestehende Verträge mit CDN-, Cloud- und MAM-Partnern.

Die heutige Einführung von Eluvios „Bucharest Release“ und EVIE markiert einen Wendepunkt: KI-Videoanalyse wird vom nachgelagerten Service zum integralen Bestandteil der globalen Streaming-Infrastruktur. Wer früh experimentiert, kann nicht nur Kosten senken, sondern vor allem neue, datengetriebene Geschäftsmodelle im Live-Sport und Entertainment etablieren.

Häufig gestellte Fragen (FAQ)

Was ist Eluvios „Bucharest Release“ und welche Rolle spielt die Content Fabric dabei?

Eluvios „Bucharest Release“ ist eine Weiterentwicklung der Content Fabric, die Broadcast-Distribution, OTT-Streaming und Inline-AI-Video-Intelligence in einer einheitlichen Plattform bündelt. Anstatt separate Systeme für Ingest, Transcoding, CDN und Analyse zu nutzen, wird das Videomaterial als adressierbares Objekt in einer Fabric gespeichert, auf der sowohl Verteilung als auch KI-Analysen direkt stattfinden.

Wie funktioniert Inline-AI-Video-Intelligence im Vergleich zu klassischen, batch-basierten Workflows?

Bei Inline-AI-Video-Intelligence werden KI-Analysen direkt in der Streaming-Fabric ausgeführt, ohne zusätzliche Datei-Kopien oder erneutes Transcoding. Statt Export, separater Analyse und anschließendem Rückimport der Metadaten werden Szenen, Objekte und Ereignisse frame-genau im laufenden Signal erkannt und sofort für Clips, Kapitel oder personalisierte Feeds nutzbar.

Welche konkreten Vorteile bietet EVIE für Live-Sport-Produktionen und Rechteinhaber?

EVIE ermöglicht es, Ereignisse wie Tore oder Key Plays automatisch zu erkennen, in Sekunden Highlight-Clips zu generieren und diese mit reichhaltigen Metadaten zu versehen. Rechteinhaber können damit schneller personalisierte Fan-Feeds, marktspezifische Highlight-Pakete und neue Sponsoring-Formate erstellen, ohne dass für jede Version neue Dateien angelegt werden müssen.

Welche Auswirkungen hat die Bucharest-Architektur auf Infrastruktur- und Betriebskosten von Broadcastern?

Da Analyse, Distribution und Monetarisierung in einem Stack zusammengeführt werden, sinkt der Bedarf an separatem Storage, mehrfachen Transcoding-Layern und komplexen Export-/Import-Pipelines. Für größere Organisationen mit globalen Feeds kann das signifikante OPEX-Einsparungen und eine deutliche Reduzierung der Integrations- und Betriebskomplexität bedeuten.

Was ist der Unterschied zwischen einer Fabric-basierten Architektur und klassischen CDN- plus MAM-Setups?

In klassischen Setups verteilen CDNs meist fertig transkodierte Streams, während ein getrenntes MAM-System Assets, Metadaten und Workflows verwaltet und KI-Analysen oft über zusätzliche Pipelines laufen. Eine Fabric-basierte Architektur wie bei Eluvio vereint Speicherung, Verteilung, Inline-KI-Analyse und Orchestrierung im selben System, wodurch weniger Schnittstellen, weniger Datenbewegung und flexibler agentischer Automatisierung möglich werden.

Wie verändert agentische Orchestrierung mit Eluvio AI und EVIE die Workflow-Steuerung?

Statt starre Pipelines zu definieren, werden Workflows über Policies und Events gesteuert, die KI-Agenten dynamisch Clips, Versionen und Commerce-Elemente erzeugen lassen. So lassen sich etwa Social-Media-Clips, personalisierte Streams oder dynamische Bundles in Echtzeit generieren und A/B-testen, ohne jeden Prozess manuell anzustoßen.

Was sollten Broadcaster und Sportligen jetzt konkret tun, um von Bucharest und EVIE zu profitieren?

Unternehmen sollten zuerst ihre bestehende Workflow-Kette detailliert kartieren und Doppelstrukturen bei Transcoding, Storage und Analyse identifizieren. Anschließend empfiehlt sich ein klar umrissener Pilot-Use-Case – etwa automatisiertes Highlighting einer Liga – mit Benchmarking gegen heutige Kosten und Latenzen, um darauf aufbauend eine Roadmap zur möglichen Migration auf eine konsolidierte Fabric-Architektur zu entwickeln.