Andrej Karpathys autonomer KI-Forschungsagent: 700 Experimente in 2 Tagen – was das für F&E in Unternehmen bedeutet

24.03.2026

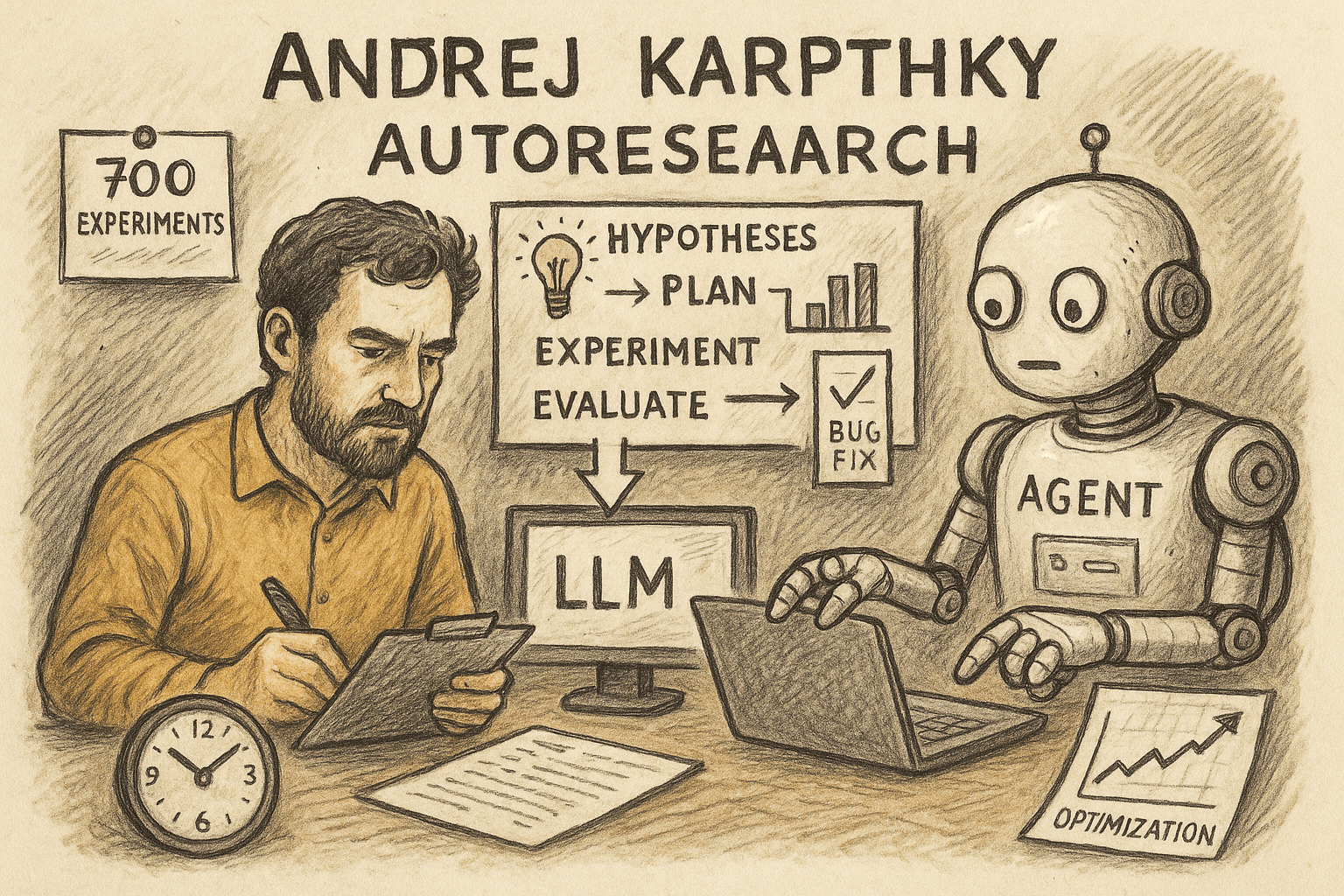

Andrej Karpathy hat mit „autoresearch“ einen autonomen KI-Forschungsagenten vorgestellt, der in rund 48 Stunden etwa 700 ML-Experimente durchläuft und dabei reale Verbesserungen an einem LLM-Trainingssetup findet – inklusive Bug-Fix im eigenen Code. Der Agent generiert Hypothesen, plant, führt aus und bewertet Experimente selbstständig. Für Unternehmen ist das ein Weckruf: F&E-, A/B‑Test- und Optimierungsprozesse lassen sich künftig massiv automatisieren. Wer Daten-, Metrik- und Governance-Strukturen nicht auf solche autonomen Forschungszyklen vorbereitet, riskiert, im Innovations-Tempo dauerhaft zurückzufallen.

Andrej Karpathys autonomer KI-Forschungsagent: 700 Experimente in 2 Tagen – was das für F&E in Unternehmen bedeutet

Was Karpathy konkret gezeigt hat

Andrej Karpathy hat mit dem Open-Source-Projekt „autoresearch“ ein minimales, aber hoch wirksames Setup demonstriert: Ein KI-Agent optimiert ein kleines LLM-Trainingsprojekt („nanochat“) vollständig autonom.

Kernpunkte des Experiments:

Laufzeit: ca. 48 Stunden auf einer einzelnen H100-GPU

Umfang: rund 700 Experimente bzw. Code-/Konfigurationsänderungen

Ergebnis: ca. 20 Änderungen, die konsistent die Performance verbessern und sich kumulativ anwenden lassen

Messbare Verbesserung: die Zeit, um einen bestimmten GPT‑2‑Benchmark zu erreichen, verkürzte sich um rund 11 % (von ca. 2,02 h auf 1,80 h)

Qualitativer Effekt: der Agent fand u. a. einen echten Bug in Karpathys eigener Implementierung (eine fehlende Skalierung in einer Attention-Normierung)

Wichtig: Der Mensch definiert Ziele, Budget und den Rahmen – die eigentliche Forschungs-Schleife (hypothesize → experiment → evaluate → iterate) läuft jedoch autonom.

Wie der autonome Forschungszyklus funktioniert

Karpathys Setup folgt einem klar strukturierten Loop, der sich auf andere Domänen übertragen lässt:

Formalisierte Ziel- und Metrikdefinition

In einer Markdown-Datei beschreibt der Mensch:

- Ziel (z. B. „Training schneller machen bei gleicher Qualität“)

- zulässige Eingriffe (Hyperparameter, Architektur-Flags, bestimmte Codebereiche)

- Kernmetrik(en) und Nebenbedingungen (z. B. Trainingszeit, Loss, Stabilität)

Hypothesengenerierung durch das LLM

Der Agent analysiert Code, Logs und bisherige Ergebnisse und schlägt konkrete Änderungen vor – etwa andere Lernratenpläne, Layer-Varianten oder Normalisierungsstrategien.

Automatisierte Experimentplanung und ‑durchführung

- Jede Änderung wird als eigenständiges Experiment gekapselt.

- Trainingsbudget pro Run ist strikt begrenzt (z. B. fünf Minuten), um viele Varianten vergleichbar testen zu können.

- Der Agent interagiert über CLI und Skripte mit der Trainingsumgebung.

Auswertung, Vergleich und Auswahl

- Metriken werden automatisiert aus Logs gelesen.

- Der Agent bewertet, ob eine Änderung signifikant besser, schlechter oder neutral ist.

- Erfolgreiche Änderungen werden in einen „Best-of“-Branch übernommen, schlechte verworfen.

Sicherheit und Rollback

Bestimmte Dateien gelten als „Danger Zone“ und sind für den Agenten gesperrt; fehlgeschlagene Runs werden automatisch zurückgesetzt.

Dieses Muster ist generisch: Alles, was sich als Experimentschleife mit klaren Metriken formulieren lässt, kann prinzipiell so automatisiert werden.

Relevante Use Cases für Unternehmen

1. ML- und Datenprodukte

Hyperparameter- und Architektur-Tuning: Autonome Agenten durchsuchen kontinuierlich den Raum möglicher Modelle, Konfigurationen und Trainingspipelines.

Feature-Engineering: Der Agent schlägt neue Features vor, baut sie ein, evaluiert sie und dokumentiert Gewinne oder Verluste.

Pipeline-Härtung: Wie im Beispiel können Bugs, numerische Instabilitäten oder Edge Cases gefunden werden, die manuellen Reviews entgehen.

2. Produkt- und UX-Optimierung

Übertragbar auf:

A/B-Testing: Agenten definieren Varianten (z. B. Layout, Copy, Ranking-Logik), orchestrieren Experimente und priorisieren nächste Tests basierend auf Impact und Unsicherheit.

Personalisierung: Permanente Feinjustierung von Recommender-Strategien oder Pricing-Heuristiken unter definierten Guardrails (z. B. Fairness-Regeln, Margenziele).

3. Software- und Infrastruktur-Experimente

Performance-Optimierung: Systematische Variation von Caching-Strategien, Datenbank-Parametern, Parallelisierungsgraden.

Resilienz-Tests: Automatisierte „Game Days“, bei denen Agenten gezielt Ausfall- und Lastszenarien generieren und Abwehrstrategien testen.

Was jetzt wirklich neu ist

Viele Bausteine – AutoML, Bayesian Optimization, CI/CD – existieren seit Jahren. Neu an Karpathys Demonstration sind u. a.:

End-to-End-Agentik statt isolierter Optimierer

Der gleiche Agent liest Code, schlägt Experimente vor, modifiziert Files, startet Training, analysiert Logs und entscheidet eigenständig über Merge oder Revert.

Hohe Iterationsgeschwindigkeit bei niedriger Komplexität des Frameworks

Das System bleibt bewusst minimalistisch (Markdown-Briefing, wenige Skripte), erreicht aber hunderte Experimente in zwei Tagen – ohne human-in-the-loop zwischen den Runs.

Qualitativ neue Fehlertypen und Chancen

Dass der Agent einen echten Logik-Bug im Code des Autors findet, ist ein starkes Signal: Agenten sind nicht nur „Parameter-Dreher“, sondern vollwertige Review-Partner.

Öffentlicher, reproduzierbarer Referenzfall

Im Gegensatz zu proprietären Auto-Research-Systemen großer Labs liegt hier ein öffentlich nachvollziehbares Setup vor – ein Blaupause für interne Agenten in Unternehmen.

Implikationen für Unternehmen und Organisationen

1. Daten- und Experimentinfrastruktur wird zum Engpass

Um autonome Forschungsagenten sinnvoll einsetzen zu können, brauchen Unternehmen:

Standardisierte Logging- und Metriksysteme (inkl. Versionierung von Datensätzen, Modellen, Konfigurationen).

Reproduzierbare Experimente: Containerisierte Umgebungen, Infrastructure-as-Code, klar definierte Seeds und Budgets.

Zugriffs- und Rechtemanagement: Feingranulare Kontrolle, welche Systeme der Agent verändern oder ausführen darf.

Ohne diese Grundlage laufen Agenten entweder ins Leere oder werden zum Risiko.

2. Governance, Compliance und Budgetkontrolle

Bei hunderten Experimenten in 48 Stunden stellen sich neue Steuerungsfragen:

Wer trägt Verantwortung?

Trotz Autonomie muss klar sein, welche Person oder Funktion (z. B. „Principal Investigator“ oder Product Owner) Ziele, Leitplanken und Freigaben definiert.

Budget- und Ressourcenkontrolle:

GPU-Stunden, API-Tokens und Cloud-Kosten müssen pro Agentenlauf begrenzt und transparent reportet werden.

Auditierbarkeit:

Für Regulierung, interne Revision oder Kundenvorgaben (z. B. im Finanz- oder Gesundheitsbereich) müssen Entscheidungen und Experimente nachvollziehbar sein: Welche Hypnose, welches Experiment, welches Ergebnis, welche Änderung?

3. Organisations- und Rollenwandel

Forschende und Entwickler:innen werden zu „Agenten-Architekt:innen“:

Der Schwerpunkt verlagert sich von manueller Kleinarbeit hin zur Gestaltung der Ziele, Datenschnittstellen, Constraints und Evaluationslogiken.

Interdisziplinäre Governance-Boards:

IT, Fachbereich, Legal/Compliance und ggf. Betriebsrat müssen gemeinsam definieren, welche Freiheitsgrade Agenten in welchen Domänen haben dürfen.

Skill-Shift:

Kompetenzen in experimentellem Design, Kausal- und Statistikverständnis werden noch wichtiger – nicht um jede einzelne Auswertung selbst zu rechnen, sondern um Agenten sinnvoll zu steuern und Ergebnisse einzuordnen.

Konkrete nächste Schritte für Unternehmen (12–18 Monate)

Pilot-Domain auswählen

- Ideal: klar messbare Ziele, geringe regulatorische Risiken, gute Datengrundlage.

- Beispiele: Model-Tuning für interne Suchfunktionen, E-Mail-Response-Ranking, System-Performance-Benchmarks.

Experiment-Backbone aufbauen

- Einheitliche Struktur für Experimente (Config, Code, Daten, Metriken).

- Automatisierte Erfassung und Speicherung aller Runs.

Einen ersten Forschungsagenten prototypisch einführen

- Start mit engen Guardrails (nur bestimmte Files, klares Zeit- und Kostenbudget).

- Menschliche Reviewpflicht vor jedem Merge in Produktions-Branches.

Governance-Richtlinien definieren

- Verantwortlichkeiten, Freigabeprozesse, Dokumentationspflichten.

- Umgang mit Bugs, Fehlentscheidungen und „Risky Experiments“.

Lernschleife etablieren

- Regelmäßige Reviews: Welche Arten von Experimenten funktionieren gut, wo scheitert der Agent, welche Guardrails müssen angepasst werden?

- Parallel Aufbau interner Kompetenz (Trainings, Guidelines, Code-Beispiele).

Fazit: Der Takt von F&E ändert sich – jetzt Infrastruktur und Governance vorbereiten

Karpathys Demonstration markiert einen Wendepunkt: Ein einzelner, relativ einfacher KI-Agent kann in zwei Tagen mehr konsistente Experimente durchführen als viele Teams in mehreren Wochen – und dabei reale Performancegewinne und Bugfixes liefern.

Für Unternehmen bedeutet das:

Forschungs- und Optimierungszyklen werden zu einem immer stärker automatisierten, permanent laufenden Prozess.

Differenzierung entsteht weniger durch einzelne Modelle, mehr durch die Qualität der eigenen Agenten-Workflows, Datenbasis und Governance-Strukturen.

Wer heute beginnt, seine F&E-, Daten- und Compliance-Landschaft auf autonome Forschungsagenten vorzubereiten, schafft sich einen strukturellen Geschwindigkeitsvorteil, der sich nur schwer aufholen lässt.

Häufig gestellte Fragen (FAQ)

Was ist Andrej Karpathys autonomer KI-Forschungsagent „autoresearch“?

„Autoresearch“ ist ein von Andrej Karpathy vorgestellter, autonomer KI-Forschungsagent, der eigenständig Machine-Learning-Experimente plant, ausführt und auswertet. In seinem Demonstrator optimiert der Agent ein LLM-Trainingssetup, findet Performanceverbesserungen und sogar Bugs im Code – bei klar definierten Zielen und Rahmenbedingungen durch den Menschen.

Wie funktioniert der autonome Forschungszyklus in Karpathys Setup konkret?

Der Forschungszyklus folgt einem Loop aus Zieldefinition, Hypothesengenerierung, automatisierter Experimentdurchführung und Auswertung. Der Agent liest Code und Logs, schlägt Änderungen vor, führt begrenzte Trainingsruns durch, bewertet die Ergebnisse anhand definierter Metriken und übernimmt nur die nachweislich besseren Varianten in einen Best-of-Branch.

Welche Auswirkungen haben autonome Forschungsagenten auf F&E in Unternehmen?

Autonome Forschungsagenten können die Anzahl und Geschwindigkeit von Experimenten massiv erhöhen und dadurch Optimierungs- und Innovationszyklen stark verkürzen. Gleichzeitig verschiebt sich der Fokus der F&E-Teams hin zur Definition von Zielen, Guardrails, Daten- und Metrikstrukturen sowie zur Interpretation der Agenten-Ergebnisse.

Worin unterscheidet sich Karpathys Ansatz von klassischem AutoML oder A/B-Testing?

Im Gegensatz zu isolierten Optimierern wie klassischem AutoML oder einzelnen A/B-Tests handelt es sich bei Karpathys Ansatz um einen End-to-End-Agenten. Dieser durchläuft den gesamten Prozess von Code-Analyse über Experimentdesign bis zum Merge oder Revert von Änderungen und agiert damit als vollwertiger Forschungs-Partner statt nur als Parameter-Tuner.

Für welche Use Cases in Unternehmen eignen sich solche autonomen Forschungsagenten besonders?

Geeignete Use Cases sind vor allem Bereiche mit klar messbaren Metriken und vielen Experimentvarianten, etwa Hyperparameter- und Architektur-Tuning, Feature-Engineering oder A/B-Tests in Produkt- und UX-Optimierung. Auch Performance- und Resilienz-Experimente in Software- und Infrastrukturumgebungen lassen sich durch autonome Agenten stark beschleunigen.

Welche Voraussetzungen müssen Unternehmen schaffen, um autonome Forschungsagenten sicher einzusetzen?

Unternehmen benötigen eine standardisierte Experiment- und Dateninfrastruktur mit sauberem Logging, Versionierung und reproduzierbaren Umgebungen. Zusätzlich sind klare Governance-Regeln, Rollen- und Verantwortlichkeitsdefinitionen, Budget- und Zugriffsbegrenzungen sowie Auditierbarkeit der Experimente entscheidend, um Risiken zu kontrollieren.

Was sollten Unternehmen in den nächsten 12–18 Monaten konkret tun?

Unternehmen sollten zunächst eine risikoarme Pilot-Domain mit klaren Metriken auswählen und darauf einen einheitlichen Experiment-Backbone aufbauen. Darauf aufbauend empfiehlt sich ein erster Pilot-Agent mit engen Guardrails, begleitet von Governance-Richtlinien, regelmäßigen Reviews und dem gezielten Aufbau von Kompetenz in experimentellem Design und Statistik.