10.04.2026

LLMs im Kundenservice: 70% Kostenersparnis nutzen

Erfahren Sie, wie LLMs im Kundenservice bis zu 70% Kosten sparen. Praxisbeispiele, Implementierungsstrategien und Grenzen für Führungskräfte erklärt.

LLMs im Kundenservice: 70% Kostenersparnis nutzen

Führende deutsche Unternehmen erzielen durch den Einsatz von Large Language Models (LLMs) im Kundenservice Kostensenkungen bis zu 70% und Wartezeitreduktion um 83%. Trotz dieser eindrucksvollen Zahlen zögern viele Führungskräfte, da Zweifel an Qualität und Kundenbindung bestehen bleiben. Dieser Leitfaden zeigt Ihnen, wie Sie LLMs erfolgreich einsetzen, welche Grenzen Sie beachten müssen und wie Sie durch hybride Modelle sowohl Effizienz als auch Servicequalität sichern. Sie erfahren, welche Strategien bei dm-drogerie markt, Zalando und Kömpf24 funktionieren und wie Sie typische Implementierungsfehler vermeiden.

Inhaltsverzeichnis

Wesentliche erkenntnisse zur rolle von LLMs im kundenservice

Grundlagen: was sind LLMs und wie unterstützen sie den kundenservice

Praxisbeispiele aus deutschland: ergebnisse und effizienzgewinne mit LLMs

Herausforderungen und grenzen von LLMs im kundenservice

Strategien für erfolgreiche implementierung und zukunftsausblick

Innovative KI-Lösungen für ihren kundenservice mit EcomTask

Häufige fragen zur rolle von LLMs im kundenservice

Wichtige Erkenntnisse

Punkt | Details |

|---|---|

Automatisierung im Support | LLMs automatisieren Antworten, Ticketklassifikation und Zusammenfassungen und senken damit den Arbeitsaufwand. |

Kosten und Bearbeitungszeit | Der Einsatz führt zu Kostensenkungen von bis zu 70 Prozent und zu deutlich schnelleren Bearbeitungsprozessen. |

Hybridmodelle für Qualität | Hybride Modelle verbinden KI-Effizienz mit menschlicher Expertise, um Servicequalität sicherzustellen. |

RAG und Wissensbasis | RAG nutzt die firmeneigene Wissensdatenbank und kombiniert Inhalte mit Sprachfähigkeit damit faktengetreue Antworten entstehen. |

Eskalation und Transparenz | Bei komplexen Anfragen sind klare Eskalationspfade und Transparenz notwendig, um Kundenzufriedenheit zu wahren. |

Grundlagen: was sind LLMs und wie unterstützen sie den kundenservice

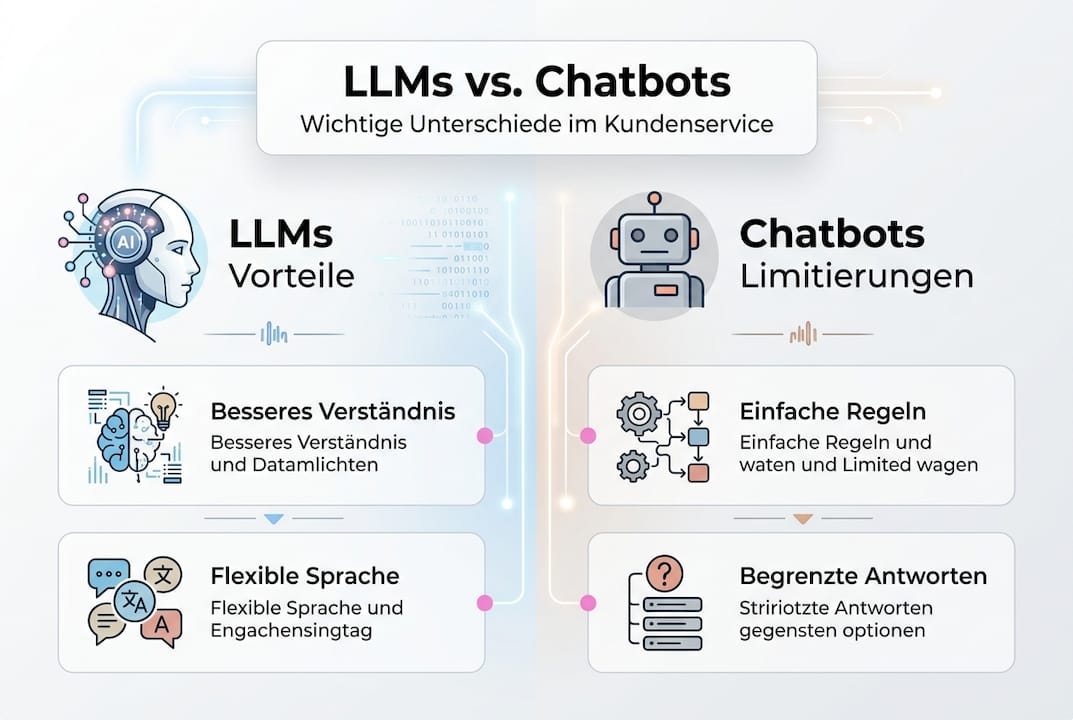

Large Language Models sind neuronale Netzwerke, die auf Milliarden von Textdaten trainiert wurden und menschenähnliche Sprache verstehen und generieren können. Im Gegensatz zu regelbasierten Chatbots lernen LLMs automatisieren Antwortgenerierung, Ticketklassifikation und Textzusammenfassung über Methoden wie RAG kontinuierlich aus Kontexten und passen ihre Antworten dynamisch an. Sie analysieren Kundenanfragen semantisch, identifizieren Absichten und liefern präzise Lösungen ohne vorprogrammierte Entscheidungsbäume.

Die wichtigsten Einsatzbereiche im Kundenservice umfassen:

Automatische Beantwortung wiederkehrender Anfragen mit kontextbezogenen, individualisierten Antworten

Intelligente Ticketklassifikation und Priorisierung nach Dringlichkeit und Komplexität

Zusammenfassung langer Kundenhistorien für schnellere Bearbeitung durch Servicemitarbeiter

Echtzeit-Übersetzung für mehrsprachigen Support ohne zusätzliche Ressourcen

Sentiment-Analyse zur Identifikation unzufriedener Kunden und proaktiver Eskalation

Retrieval-Augmented Generation (RAG) hat sich als besonders effektive Methode etabliert. Dabei greift das LLM auf Ihre unternehmenseigene Wissensdatenbank zu und kombiniert diese Informationen mit seiner Sprachfähigkeit. So entstehen Antworten, die sowohl faktisch korrekt als auch natürlich formuliert sind. Diese Technik verhindert, dass das Modell Informationen erfindet, und stellt sicher, dass nur geprüfte Unternehmensinhalte kommuniziert werden.

Gegenüber klassischen Chatbots bieten LLMs entscheidende Vorteile. Sie verstehen Nuancen, Umgangssprache und selbst unvollständige Anfragen. Während traditionelle Systeme bei Abweichungen vom Skript versagen, interpretieren LLMs die Intention hinter der Frage. Für KI im Kundenservice bedeutet dies eine drastisch verbesserte Erstlösungsquote.

Profi-Tipp: Der Kontext Ihrer Prompts bestimmt die Qualität der Antworten maßgeblich. Definieren Sie klare Rollen für das LLM (z.B. “Sie sind ein technischer Support-Spezialist”), geben Sie Beispiele für gewünschte Antworten und legen Sie Grenzen fest (“Bei Fragen zu Rechnungen eskalieren Sie an die Finanzabteilung”). Je präziser Ihre Anweisungen, desto konsistenter die Ergebnisse.

Praxisbeispiele aus deutschland: ergebnisse und effizienzgewinne mit LLMs

Deutsche Unternehmen verschiedener Größenordnungen haben LLMs erfolgreich implementiert und dokumentieren beeindruckende Resultate. Bei Kömpf24 führte der Einsatz eines KI-Telefonassistenten zu messbaren Verbesserungen: Wartezeitreduzierung um 83%, Bearbeitungszeit um 80% gesenkt bei gleichzeitiger Steigerung der Kundenzufriedenheit. Das mittelständische Unternehmen automatisierte Standardanfragen vollständig und entlastete sein Team für komplexe Beratungsgespräche.

dm-drogerie markt nutzt LLMs zur Analyse von Kundenrezensionen und automatischen Kategorisierung von Support-Tickets. Die KI identifiziert Trends in Kundenfeedback und leitet relevante Erkenntnisse direkt an Produktmanagement und Marketing weiter. Zalando setzt auf LLM-gestützte Chatbots für Größenberatung und Retourenmanagement, wodurch die Retouren-Quote messbar sank.

Die folgende Tabelle zeigt konkrete Effizienzgewinne aus dokumentierten Fallstudien:

Unternehmen | Einsatzbereich | Zeitersparnis | Kostenreduktion | Zusatzeffekt |

|---|---|---|---|---|

Kömpf24 | Telefonischer Support | 80% schnellere Bearbeitung | 70% niedrigere Kosten | 83% kürzere Wartezeiten |

dm-drogerie markt | Ticket-Klassifikation | 65% weniger manuelle Sortierung | 55% Personalentlastung | Trend-Erkennung in Echtzeit |

Zalando | Chat-Support & Retouren | 70% automatisierte Anfragen | 60% Support-Kosten gespart | 15% weniger Retouren |

Diese Fallstudien belegen Einsparungen bis zu 70% der Kosten und zeigen, dass ROI bereits nach 6 bis 12 Monaten erreicht werden kann. Entscheidend ist jedoch die richtige Integration: Erfolgreiche Unternehmen haben LLMs nicht als Ersatz, sondern als Ergänzung zu menschlichen Mitarbeitern positioniert.

Für Führungskräfte ergeben sich folgende praxisnahe Handlungsempfehlungen:

Starten Sie mit klar definierten Anwendungsfällen hoher Wiederholungsrate (FAQ, Statusabfragen, Terminbuchungen)

Messen Sie Erfolg anhand konkreter KPIs: Erstlösungsquote, durchschnittliche Bearbeitungszeit, Kundenzufriedenheit

Investieren Sie in qualitativ hochwertige Trainingsdaten aus Ihrer eigenen Kundenhistorie

Etablieren Sie Feedback-Schleifen, bei denen Mitarbeiter LLM-Antworten bewerten und verbessern

Wenn Sie Kundenanfragen effizient automatisieren möchten, sollten Sie auch digitale Assistenten für Kundenservice evaluieren, die speziell für Ihre Branche entwickelt wurden.

Profi-Tipp: Beginnen Sie mit einem begrenzten Pilotprojekt in einem unkritischen Servicebereich. Sammeln Sie dort drei Monate Daten zu Genauigkeit, Kundenzufriedenheit und Eskalationsrate, bevor Sie skalieren. Diese Phase deckt Schwachstellen auf, die in der Theorie nicht sichtbar waren, und schafft intern Vertrauen in die Technologie.

Herausforderungen und grenzen von LLMs im kundenservice

Trotz beeindruckender Erfolge weisen LLMs strukturelle Schwächen auf, die Sie als Führungskraft kennen müssen. Schwächen bei komplexen Anfragen, Halluzinationen, fehlende Empathie gehören zu den häufigsten Problemen. Halluzinationen treten auf, wenn das Modell plausibel klingende, aber faktisch falsche Informationen generiert. Bei Produktspezifikationen oder rechtlichen Fragen kann dies erhebliche Risiken bergen.

Empathie und emotionale Intelligenz bleiben menschliche Stärken. Wenn Kunden frustriert sind oder komplexe persönliche Situationen schildern, wirken LLM-Antworten oft mechanisch und unangemessen. Die Modelle erkennen zwar Sentiment, können aber nicht authentisch mitfühlen oder situativ angemessen reagieren. Bei Beschwerden oder emotional aufgeladenen Themen ist menschliche Intervention unverzichtbar.

Typische Schwachstellen umfassen:

Unzuverlässigkeit bei mehrstufigen logischen Schlussfolgerungen oder mathematischen Berechnungen

Inkonsistente Antworten bei identischen Anfragen durch probabilistische Natur der Modelle

Schwierigkeiten beim Verständnis impliziter Informationen oder kultureller Kontexte

Fehlende Fähigkeit, ethische Dilemmata oder Grenzfälle zu bewerten

Anfälligkeit für manipulative Prompts (Jailbreaking), die Sicherheitsrichtlinien umgehen

Der Fall Klarna illustriert diese Grenzen eindrücklich. Das Fintech-Unternehmen ersetzte 700 Kundenservice-Mitarbeiter durch KI und musste später Qualitätsverluste bei komplexen Fällen eingestehen. Kunden beschwerten sich über unpersönliche Kommunikation und ungelöste Probleme, die menschliches Urteilsvermögen erforderten. Klarna korrigierte den Kurs und implementierte ein Hybridmodell, bei dem KI Standardfälle übernimmt und Menschen für komplexe Situationen einspringen.

“Die Lösung liegt nicht in reiner KI oder reinem Human-Support, sondern in intelligenter Orchestrierung beider Welten. Human-in-the-Loop-Systeme kombinieren Effizienz mit Qualität und schaffen Vertrauen beim Kunden.” – Branchenexperte für KI-Governance

Eskalationsmechanismen sind daher unverzichtbar. Definieren Sie klare Trigger, wann das LLM an menschliche Mitarbeiter übergibt: bei erkannter Frustration, wiederholten Rückfragen, rechtlichen Themen oder wenn das Modell selbst Unsicherheit signalisiert. Transparenz gegenüber Kunden schafft Akzeptanz. Kommunizieren Sie offen, dass ein KI-Assistent antwortet, und bieten Sie jederzeit die Option, mit einem Menschen zu sprechen.

Wenn Sie automatisierten Kundenservice neu denken möchten, sollten KI im Kundenservice Qualitätskontrolle von Anfang an integraler Bestandteil Ihrer Strategie sein.

Profi-Tipp: Implementieren Sie ein dreistufiges Konfidenz-System. Bei hoher Konfidenz (über 90%) antwortet die KI direkt. Bei mittlerer Konfidenz (70 bis 90%) schlägt sie eine Antwort vor, die ein Mitarbeiter vor dem Versand prüft. Bei niedriger Konfidenz (unter 70%) eskaliert das System sofort. Diese Abstufung minimiert Risiken und optimiert Ressourceneinsatz.

Strategien für erfolgreiche implementierung und zukunftsausblick

Eine strukturierte Implementierung entscheidet über Erfolg oder Misserfolg Ihres LLM-Projekts. Folgen Sie dieser bewährten Schritt-für-Schritt-Methode:

Prozessanalyse durchführen: Identifizieren Sie repetitive Anfragen mit hohem Volumen und standardisierbaren Antworten. Analysieren Sie Ihre Ticket-Historie der letzten 12 Monate nach Häufigkeit, Komplexität und durchschnittlicher Bearbeitungszeit.

Datenqualität sicherstellen: Bereinigen Sie Ihre Wissensdatenbank, entfernen Sie veraltete Informationen und strukturieren Sie Inhalte für RAG-Zugriff. Qualität der Trainingsdaten bestimmt direkt die Qualität der Antworten.

Pilotprojekt definieren: Wählen Sie einen klar abgegrenzten Anwendungsfall mit messbaren KPIs. Die 4D-Pilotenmethode (Define, Deploy, Develop, Deliver) hat sich als praxisnah bewährt.

Hybridmodell etablieren: Kombinieren Sie KI-Automatisierung mit menschlicher Expertise durch klare Eskalationsregeln. Definieren Sie, wann und wie Übergaben erfolgen.

Mitarbeiter schulen: Trainieren Sie Ihr Team im Umgang mit KI-generierten Vorschlägen, im Feedback-Geben und in der Übernahme eskalierter Fälle. Positionieren Sie LLMs als Unterstützung, nicht als Bedrohung.

Kontinuierlich monitoren: Etablieren Sie Dashboards für Erstlösungsquote, Eskalationsrate, Kundenzufriedenheit und Genauigkeit. Analysieren Sie wöchentlich Fehler und optimieren Sie Prompts.

Skalieren und erweitern: Nach erfolgreichem Pilot weiten Sie den Einsatz schrittweise auf weitere Bereiche aus, immer begleitet von Messungen und Anpassungen.

Der Vergleich verschiedener Servicemodelle zeigt klare Unterschiede:

Modell | Effizienz | Qualität komplexer Fälle | Kosten | Skalierbarkeit | Empfehlung |

|---|---|---|---|---|---|

Rein KI-getrieben | Sehr hoch (90%+ Automatisierung) | Niedrig | Sehr niedrig | Unbegrenzt | Nur für einfache Standardfälle |

Hybridmodell | Hoch (70% Automatisierung) | Hoch | Mittel | Hoch | Optimal für die meisten Unternehmen |

Rein menschlich | Niedrig | Sehr hoch | Sehr hoch | Begrenzt | Nur für hochspezialisierte Premium-Services |

Die Marktentwicklung unterstreicht die strategische Bedeutung dieser Technologie. Marktwachstum für Enterprise-LLMs erwartet CAGR 30% von 5,91 Milliarden USD in 2024 auf 48,25 Milliarden USD in 2034. Dieser exponentielle Anstieg signalisiert, dass LLMs zum Standard im Kundenservice werden. Early Adopters sichern sich Wettbewerbsvorteile durch Effizienzgewinne und verbesserte Customer Experience.

Zukünftige Entwicklungen werden multimodale Fähigkeiten umfassen: LLMs, die nicht nur Text, sondern auch Bilder, Audio und Video verarbeiten. Stellen Sie sich vor, ein Kunde fotografiert ein defektes Produkt, und die KI erkennt das Problem visuell und schlägt sofort Lösungen vor. Diese Technologien sind bereits in Entwicklung und werden in den nächsten zwei Jahren marktreif.

Für Best Practices für KI im Unternehmen sollten Sie auch multimodale KI-Modelle im Blick behalten. Investieren Sie parallel in KI-Schulung und Training Ihrer Teams, um die Technologie optimal zu nutzen.

Profi-Tipp: Etablieren Sie ein LLM-Governance-Board mit Vertretern aus IT, Kundenservice, Recht und Datenschutz. Dieses Gremium definiert Richtlinien, überwacht Compliance und entscheidet über Erweiterungen. Gute Governance verhindert unkontrollierte Experimente und sichert nachhaltigen Erfolg.

Innovative KI-Lösungen für ihren kundenservice mit EcomTask

Sie haben nun fundiertes Wissen über Potenziale und Grenzen von LLMs im Kundenservice. Der nächste Schritt ist die praktische Umsetzung in Ihrem Unternehmen. EcomTask unterstützt Sie dabei mit maßgeschneiderten KI-Lösungen, die auf Ihre spezifischen Prozesse zugeschnitten sind.

Unsere Experten analysieren Ihre Kundenservice-Workflows, identifizieren Automatisierungspotenziale und entwickeln KI-Mitarbeiter, die nahtlos in Ihre bestehenden Systeme integriert werden. Wir kombinieren bewährte LLM-Technologie mit Ihrer Unternehmenswissensdatenbank und schaffen so Lösungen, die sowohl effizient als auch qualitativ hochwertig sind. Von der initialen Prozessanalyse über die Implementierung bis zur kontinuierlichen Optimierung begleiten wir Sie auf dem gesamten Weg zur KI-gestützten Serviceexzellenz.

Erfahren Sie mehr darüber, wie Sie automatisierten Kundenservice neu denken können. Entdecken Sie unsere Ansätze zur KI-gestützten Geschäftsautomatisierung und lernen Sie die Möglichkeiten von Intelligence Automation und AI-Assistenten kennen.

Häufige fragen zur rolle von LLMs im kundenservice

Was unterscheidet LLMs von klassischen Chatbots im Kundenservice?

LLMs verstehen natürliche Sprache semantisch und generieren kontextbezogene Antworten, während klassische Chatbots auf vordefinierte Regeln und Entscheidungsbäume angewiesen sind. LLMs passen sich dynamisch an verschiedene Formulierungen an und lernen aus Kontext, wodurch sie deutlich flexibler und natürlicher kommunizieren. Klassische Chatbots versagen bei Abweichungen vom Skript, LLMs interpretieren die Intention hinter der Frage.

Wann sind menschliche Eingriffe im LLM-gestützten Kundenservice unverzichtbar?

Menschliche Mitarbeiter müssen bei emotional aufgeladenen Situationen, komplexen Sonderfällen, rechtlichen Fragestellungen und wenn Kunden explizit menschlichen Kontakt wünschen, eingreifen. Auch bei wiederholten Rückfragen des Kunden oder wenn das LLM selbst niedrige Konfidenz signalisiert, ist Eskalation notwendig. Ethische Dilemmata und Entscheidungen mit weitreichenden Konsequenzen erfordern immer menschliches Urteilsvermögen.

Welche Kosteneinsparungen sind durch LLMs im Kundenservice realistisch?

Dokumentierte Fallstudien zeigen Einsparungen zwischen 55% und 70% der Kundenservice-Kosten, abhängig vom Automatisierungsgrad und der Komplexität der Anfragen. Realistische Erwartungen für Hybridmodelle liegen bei 40% bis 60% Kostenreduktion innerhalb von 12 Monaten nach Implementierung. Der ROI wird typischerweise nach 6 bis 12 Monaten erreicht, wenn die Implementierung strukturiert erfolgt und kontinuierlich optimiert wird.

Wie wichtig ist Datenqualität für den Erfolg von LLMs im Kundenservice?

Datenqualität ist der kritischste Erfolgsfaktor. LLMs lernen aus Ihren Trainingsdaten und greifen via RAG auf Ihre Wissensdatenbank zu. Veraltete, inkonsistente oder fehlerhafte Informationen führen direkt zu falschen Antworten und Halluzinationen. Investieren Sie vor der Implementierung in Bereinigung, Strukturierung und Aktualisierung Ihrer Wissensbasis. Etablieren Sie Prozesse für kontinuierliche Datenpflege, damit die KI-Qualität langfristig hoch bleibt.

Welche ersten Schritte empfehlen Sie zur Einführung von LLMs in unserem Unternehmen?

Starten Sie mit einer gründlichen Analyse Ihrer Kundenservice-Tickets der letzten 12 Monate, um repetitive Anfragen mit hohem Volumen zu identifizieren. Wählen Sie einen klar abgegrenzten Pilotbereich mit standardisierbaren Antworten und definierten Erfolgskriterien. Implementieren Sie ein Hybridmodell mit klaren Eskalationsregeln und schulen Sie Ihr Team parallel. Messen Sie kontinuierlich KPIs wie Erstlösungsquote und Kundenzufriedenheit. Nutzen Sie die KI im Kundenservice Checkliste für eine strukturierte Vorgehensweise.